面对AI多镜头连贯性危机,入选CVPR的STAGE框架以起始与结束帧对预测取代传统关键帧,让算法真正掌握导演级分镜转场艺术。

视觉狂欢背后的多镜头连贯性危机

从Sora到Seedance 2.0,视频生成大模型的视觉表现力屡创巅峰,但当创作者试图用其拼接一个完整故事时,叙事连贯性的短板便暴露无遗。目前行业主流的多镜头生成方案主要分为两条路线 一镜到底的端到端生成以及基于关键帧的分布演进。前者计算成本极其高昂且宛如开盲盒,创作者几乎无法控制中间过程;后者虽然提供了操作灵活性,但模型往往只能死板地记住几个核心画面的样貌,完全缺乏对镜头衔接逻辑的理解。

这种机制上的缺陷,直接导致了生成视频中频繁出现灾难性的画面断层。前一个镜头人物穿着红衣,下一个镜头便发生色彩跳跃,或者在推进特写时物体出现不符合物理规律的瞬移。这种现象的本质在于,当前的AI依然停留在画单帧的阶段,缺乏专业导演对镜头起承转合的统筹能力。

骨架重塑与双帧预测的叙事革命

为了解决跨镜头逻辑断裂的痛点,研究团队提出了以电影分镜为核心的叙事生成框架STAGE。该框架彻底抛弃了稀疏关键帧的传统路径,创新性地将生成任务重构为起始帧与结束帧对的联合预测。

对于每一个独立的镜头,STAGE不再仅仅输出一个极具代表性的画面,而是直接锚定镜头的首尾两帧。这一机制的转变带来了显著的结构化优势。所有镜头的首尾帧依次串联,在时间轴上搭建起极其稳固的视觉骨架,从根本上锁定了角色特征与场景元素的长期一致性。同时,首尾两帧的明确界定,为镜头内部的动态演变提供了清晰的导航航向,让平移、推拉等复杂运镜有了明确的物理终点。更重要的是,前一镜头的结束与后一镜头的起始之间形成了直接的映射关系,对影视剪辑中的转场语言进行了深度数学建模,使画面衔接呈现出丝滑的电影质感。

赋予算法导演思维的三大核心技术

支撑这一工作流运转的是被称为STEP2的核心预测模型。为了让这个数字导演具备专业级的场面调度能力,研究团队为其植入了三项关键技术。

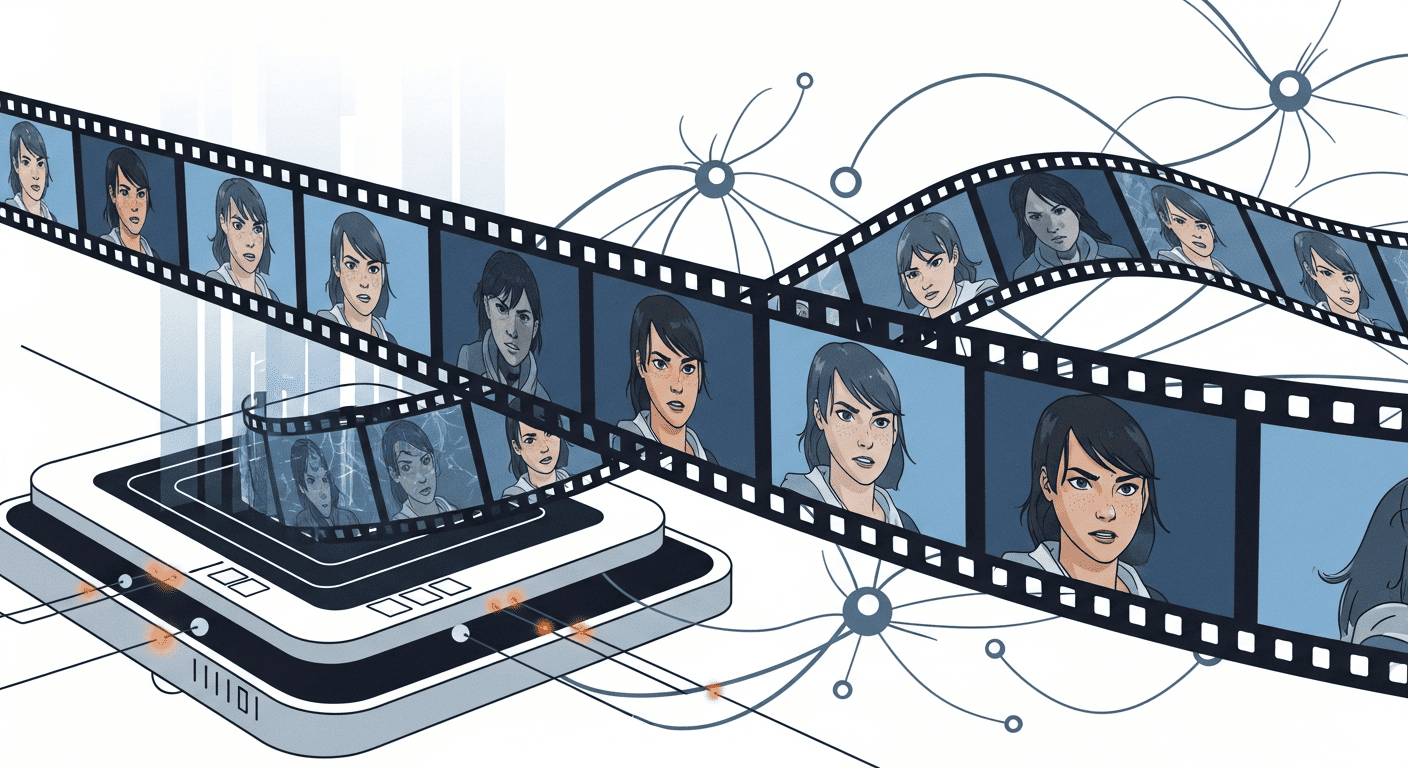

多镜头记忆包机制是第一道保障。该技术通过高效的压缩算法,将冗长的历史镜头视觉信息打包提炼,确保算法在渲染后续镜头时依然能准确回溯初始场景的细节,成功规避了角色特征在长程叙事中的偏移风险,同时大幅降低了算力开销。

双重编码策略保障了运镜的平滑。为了保障单镜头内部的运动逻辑自洽,系统将起始帧与结束帧进行深度捆绑和联合编码,使得算法在动笔生成的第一秒,就已经完成了对整个镜头运动轨迹的全局推演。

阶梯式的两阶段训练方案提升了审美下限。第一阶段依靠海量影视片段进行监督微调,赋予模型基础的运镜能力;第二阶段则引入人类偏好对齐机制,投喂经过精挑细选的优质转场案例,让算法在海量阅片中建立起对高级电影感的美学认知。

高质量数据集奠定工业化应用基石

为了配合全新的训练逻辑,研究团队放弃了传统聚焦于单帧画面的数据集,独立构建了规模庞大的多镜头视频库。该图库涵盖了十万个高质量电影片段,不仅对首尾帧进行了精准切分,还打上了涵盖故事推进、景别尺度、摄影机位等专业维度的结构化标签。

在行业权威的评测基准中,STAGE在场景一致性、动作流畅度以及风格维持等多个维度上,均展现出对现有主流生成工具的压倒性优势。这项技术路线的成功验证释放了一个明确的行业信号 视频生成的下半场角逐,将从单纯的像素级保真度比拼,全面转向对结构化叙事逻辑的掌控。当算法真正理解了分镜的意义,由AI辅助创作的工业级影视制作时代才真正具备了落地的可能。

相关推荐

2025 AI 技术峰会

AI 实战课程

热门工具

AI 助手

智能对话,提升效率

智能图像处理

一键美化,智能修图

AI 翻译

多语言实时翻译

评论 (0)

暂无评论,快来发表第一条评论吧!