艾伦人工智能研究所推出纯视觉驱动的全开源网络代理MolmoWeb。该模型摆脱了对网页底层代码的依赖,凭借小参数规模在多项基准测试中逼近闭源巨头,为反垄断技术探索提供新路径。

所见即所得 重塑网页交互逻辑

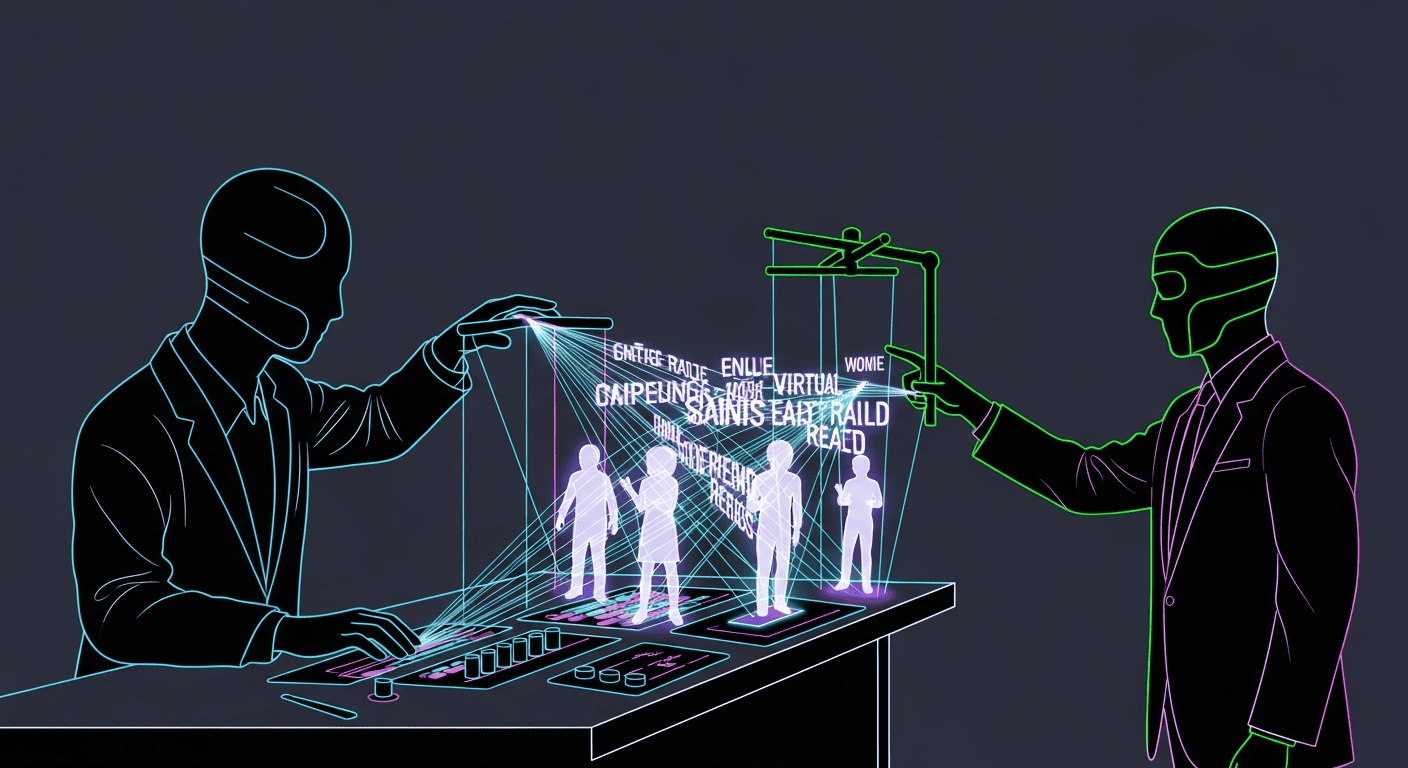

在网络自动化导航领域,长期占据主流的代码解析路线正面临强有力的挑战。艾伦人工智能研究所(AI2)近日正式对外发布了突破性的全开源网络代理模型MolmoWeb。与传统高度依赖解析网页底层DOM树(文档对象模型)的代理系统截然不同,MolmoWeb确立了纯视觉驱动的技术路线。

该代理的运作逻辑高度拟人化,它通过实时捕获当前浏览器窗口的视觉截图,利用视觉分析模块直接研判并决定下一步的操作指令(涵盖精准点击、页面滚动、多级翻页等),随后执行操作并开启新一轮的视觉捕获循环。这种所见即所得的交互模式赋予了模型极高的环境鲁棒性。由于现代网页的视觉UI布局往往比其后端代码结构更加稳定且直观,MolmoWeb的决策链路对人类开发者而言完全透明且具备极强的可解释性。

性能越级 小参数击败闭源巨头

引人注目的是,MolmoWeb在极小的参数体积下展现出了惊人的效能,其发布的4B和8B两个轻量级版本在实测中实现了以小博大。

测试榜单领跑 在严苛的WebVoyager基准测试中,8B版本模型斩获了78.2%的高分,不仅在开源阵营中确立了领先地位,其测试成绩更已无限逼近行业头部闭源模型79.3%的顶尖水平。 性能爆发潜力 研究团队的深度测试表明,通过引入多次任务运行机制并筛选最优路径结果,该模型的任务成功率天花板可大幅跃升至94.7%。 UI定位精准度 在针对用户界面元素定位的专项基准测试中,其精准度甚至超越了部分主流的大型商业闭源模型。

开放数据生态 对抗巨头垄断

秉持极简与开源的核心理念,AI2不仅在Hugging Face和GitHub等平台基于Apache 2.0协议全面开源了模型权重,更同步释放了极具价值的底层数据集MolmoWebMix。

该数据集库涵盖了由真实人类志愿者标注的超过3.6万次浏览任务轨迹,以及高达220万个屏幕截图与问答对。更具技术前瞻性的是,其中包含的大量经自动化验证的合成数据,在引导智能体探索最优路径时展现出优于人类经验的效率。尽管目前该模型在处理复杂多步指令与绕过验证机制等方面仍有优化空间,但AI2通过构建彻底透明的技术社区,正在为打破科技巨头的数据与技术双重垄断提供最具可行性的开源解法。

相关推荐

2025 AI 技术峰会

AI 实战课程

热门工具

AI 助手

智能对话,提升效率

智能图像处理

一键美化,智能修图

AI 翻译

多语言实时翻译

评论 (0)

暂无评论,快来发表第一条评论吧!